Serviços tradicionais de IA em nuvem dependem de grandes data centers centralizados, oferecendo poder computacional robusto, mas enfrentando custos elevados de GPU, agendamento centralizado e desafios de escalabilidade. O Theta EdgeCloud propõe uma solução ao integrar nós de borda à computação em nuvem, aproveitando GPUs ociosas globalmente para otimizar o uso de recursos e promover colaboração distribuída.

Com a intensificação da concorrência em infraestrutura de IA, o Theta EdgeCloud se destaca como um caso de DePIN (Decentralized Physical Infrastructure Network) e rede distribuída de GPU. Seu foco é proporcionar um modelo flexível de colaboração de recursos em cenários de inferência de IA e computação de borda, sem a pretensão de substituir integralmente as plataformas tradicionais de nuvem.

## O que é o Theta EdgeCloud

O Theta EdgeCloud é uma plataforma híbrida de IA em nuvem desenvolvida no ecossistema [Theta Network](https://www.gate.com/pt-br/learn/articles/what-is-theta-network). Sua proposta central combina Nós de Borda distribuídos e serviços tradicionais de GPU em nuvem, formando uma rede unificada de recursos computacionais.

Diferentemente dos serviços centralizados de IA em nuvem, o Theta EdgeCloud obtém poder computacional tanto de servidores em nuvem quanto de [nós Edge Node](https://www.gate.com/pt-br/learn/articles/theta-node-architecture) operados por usuários globalmente. Esses nós compartilham recursos ociosos de GPU, CPU e banda larga para tarefas de inferência de IA, transcodificação e renderização de vídeo.

Para desenvolvedores, o Theta EdgeCloud atua como uma camada dinâmica de computação de IA para recursos distribuídos. Não é necessário gerenciar nós diretamente — basta enviar as tarefas pela plataforma, que se encarrega da alocação e execução dos recursos.

## Como o Theta EdgeCloud se diferencia dos serviços tradicionais de IA em nuvem

Plataformas tradicionais de IA em nuvem dependem de grandes data centers centralizados, com o gerenciamento de recursos sob responsabilidade dos provedores. Embora seja um modelo consolidado e estável, ele sofre com escassez de GPUs e custos crescentes.

O Theta EdgeCloud, por sua vez, prioriza o “compartilhamento de recursos de borda”. Os Nós de Borda podem estar em qualquer parte do mundo, permitindo o reaproveitamento de GPUs ociosas. Ao receber uma tarefa de IA, a plataforma aloca recursos conforme as necessidades da tarefa, status dos nós e capacidade computacional.

Principais diferenças entre o Theta EdgeCloud e plataformas tradicionais de IA em nuvem:

| Dimensão de comparação | Plataforma tradicional de IA em nuvem | Theta EdgeCloud |

| --- | --- | --- |

| Fonte de recursos | Data center centralizado | GPU em nuvem + Edge Node |

| Estrutura de rede | Centralizada | Distribuída |

| Agendamento de GPU | Gerenciado pela plataforma | Coordenação dinâmica dos nós |

| Participação dos nós | Provedor de nuvem | Recursos compartilhados por usuários |

| Mecanismo de incentivo | Pagamento pelo serviço | Recompensas em TFUEL |

Essa configuração posiciona o Theta EdgeCloud como uma rede distribuída de GPU, indo além do conceito de plataforma de computação em nuvem convencional.

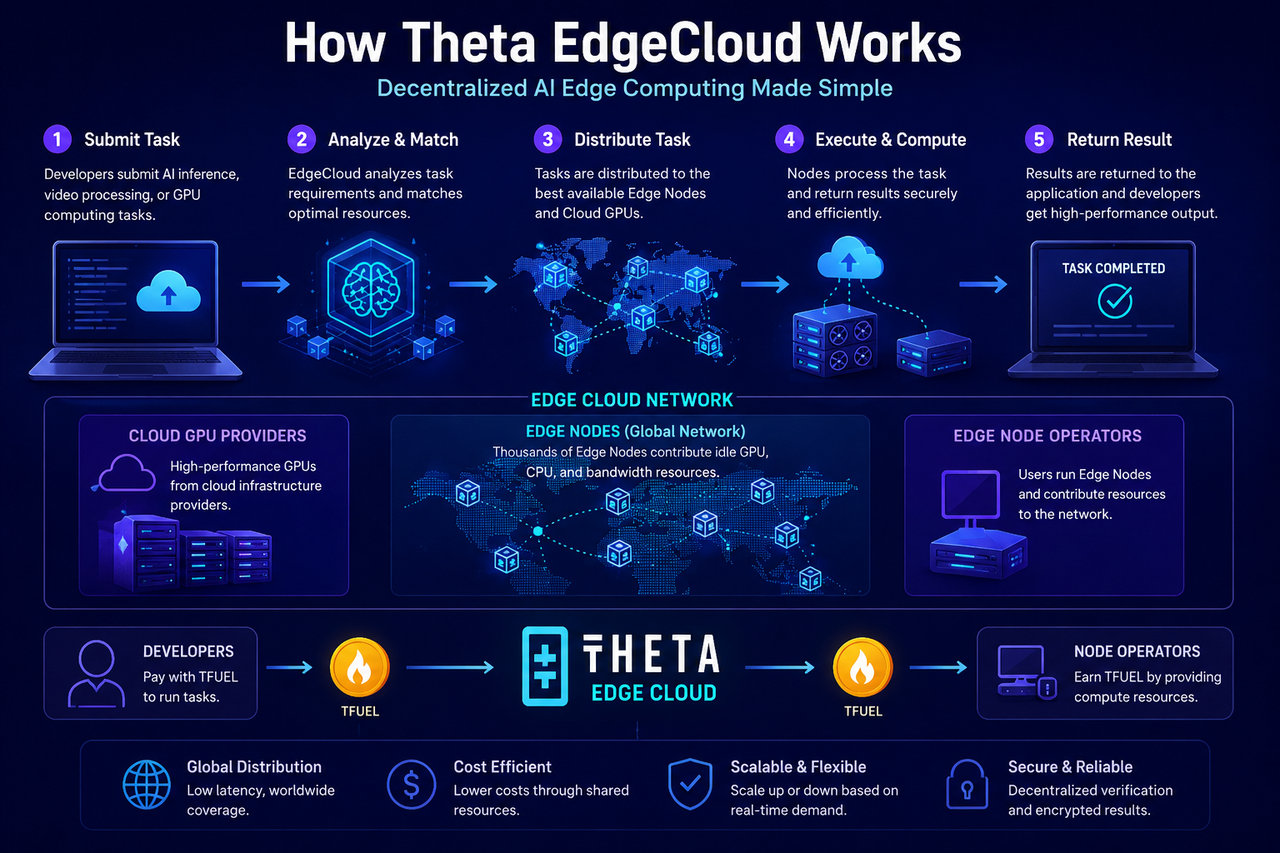

## O que acontece após o envio de uma tarefa de IA pelo usuário

Ao enviar uma tarefa de inferência de IA, processamento de vídeo ou renderização, o Theta EdgeCloud analisa os requisitos de recursos — tipo de GPU, VRAM, tempo de computação e banda larga.

O sistema identifica nós adequados na rede. Algumas tarefas são executadas por GPUs em nuvem; outras são distribuídas para Nós de Borda ao redor do mundo. Todo o processo é automatizado, dispensando a seleção manual de nós por parte dos desenvolvedores.

Durante a execução, o sistema monitora o status dos nós e o progresso das tarefas. Caso algum nó fique offline ou não tenha recursos suficientes, as tarefas são realocadas para garantir a estabilidade computacional.

Ao final, os resultados são entregues à aplicação e os nós participantes recebem [recompensas em TFUEL](https://www.gate.com/pt-br/learn/articles/theta-vs-tfuel) conforme a contribuição de recursos.

Na prática, esse modelo atua como um “sistema de agendamento distribuído de recursos”, maximizando o aproveitamento do poder computacional ocioso da rede.

## Como os Nós de Borda participam da computação em GPU

Os Nós de Borda são fundamentais para o Theta EdgeCloud. Ao rodar um Edge Node, usuários conectam seus recursos locais de GPU e computação à rede Theta.

Quando a rede demanda inferência de IA, renderização de vídeo ou computação de borda, esses nós recebem tarefas dinamicamente. Após a execução, recebem recompensas em TFUEL proporcionais à sua contribuição.

Diferentemente das máquinas de mineração tradicionais, os Nós de Borda do Theta não são voltados para mineração PoW; sua função principal é fornecer poder computacional real. Por isso, o Theta é classificado como projeto DePIN.

Para usuários, Edge Nodes representam tanto um ponto de entrada para a rede Theta quanto uma peça-chave da estrutura de compartilhamento de recursos.

## Como o TFUEL circula no EdgeCloud

O TFUEL é o token de recurso essencial do Theta EdgeCloud, viabilizando pagamentos e incentivos na rede.

Desenvolvedores pagam TFUEL ao submeter tarefas de IA ou vídeo. O sistema distribui parte do TFUEL aos Nós de Borda envolvidos, conforme o desempenho na execução das tarefas.

No EdgeCloud, o TFUEL conecta:

- Desenvolvedores de aplicações de IA

- Provedores de recursos de GPU

- A rede de Edge Node

- A infraestrutura Theta

Isso estabelece um ciclo contínuo de “pagamento pela tarefa — execução do recurso — recompensa ao nó”.

## Principais cenários de aplicação do Theta EdgeCloud

O Theta EdgeCloud é voltado principalmente para computação de IA e de mídia.

Em IA, destacam-se:

- Inferência de modelos de IA

- Inferência de grandes modelos de linguagem

- Geração de imagens

- Computação distribuída de GPU

Em vídeo e mídia, o Theta EdgeCloud oferece suporte para:

- Transcodificação de vídeo

- Renderização de vídeo

- Transmissão ao vivo

- Distribuição de conteúdo na borda

A distribuição global dos nós de borda permite que tarefas sensíveis à latência tenham menor atraso por meio da computação de borda.

Com a convergência entre IA e infraestrutura Web3, o Theta EdgeCloud torna-se peça central da expansão do Theta do segmento de vídeo para o setor de IA.

## Quais desafios o Theta EdgeCloud enfrenta

Apesar das vantagens em compartilhamento de recursos e escalabilidade, o Theta EdgeCloud enfrenta desafios práticos.

O hardware dos nós de borda é heterogêneo, e diferenças de desempenho das GPUs podem impactar a eficiência das tarefas. A natureza distribuída também torna o agendamento de recursos e a gestão de tarefas mais complexos.

O mercado de infraestrutura de IA é altamente competitivo, com plataformas tradicionais de nuvem e projetos distribuídos de GPU disputando espaço.

Além disso, o crescimento da demanda por GPUs de alto desempenho em IA generativa torna a aquisição e alocação confiável desses recursos um desafio estratégico para o EdgeCloud.

## Resumo

O Theta EdgeCloud, plataforma descentralizada de IA e computação de borda da Theta Network, busca construir uma rede distribuída de computação de IA ao combinar Nós de Borda globais e GPUs em nuvem.

Diferente dos serviços centralizados de IA em nuvem, o Theta EdgeCloud valoriza o compartilhamento de recursos de borda, a coordenação de GPU e o agendamento distribuído. Desenvolvedores enviam tarefas de inferência de IA e processamento de vídeo pela plataforma, enquanto nós globais contribuem com recursos e recebem recompensas em TFUEL.

Com a crescente demanda por inferência de IA e GPUs, o Theta EdgeCloud acelera a transição do Theta de uma rede de streaming de vídeo para uma plataforma completa de infraestrutura de IA.

## Perguntas frequentes

### Como o Theta EdgeCloud opera?

Após o envio de uma tarefa de IA ou vídeo, o sistema atribui automaticamente a execução a GPUs em nuvem e Nós de Borda, com o TFUEL sendo utilizado para pagamentos e recompensas de recursos.

### Qual é o papel dos Nós de Borda no EdgeCloud?

Os Nós de Borda fornecem recursos de GPU e computação para tarefas de inferência de IA, renderização de vídeo e computação de borda.

### Como o Theta EdgeCloud se diferencia dos serviços tradicionais de IA em nuvem?

Enquanto nuvens de IA tradicionais dependem de data centers centralizados, o Theta EdgeCloud integra nós de borda e GPUs em nuvem para formar uma rede distribuída de recursos.

### Qual é a função do TFUEL no EdgeCloud?

O TFUEL serve para pagar custos de tarefas de IA e vídeo e também como token de recompensa para nós que executam as tarefas.

### O Theta EdgeCloud é considerado um projeto DePIN?

Por priorizar o compartilhamento de recursos de GPU e computação de borda, o Theta EdgeCloud é frequentemente classificado como projeto DePIN e rede distribuída de GPU.

2026-05-08 06:25:15